据外网一份新报告称,OpenAI正在考虑如何确保运行其程序所需的更多强大的人工智能芯片,包括自研AI芯片。显然,OpenAI是目前商业领域资金最充足的人工智能初创公司之一,但对于探索制造自己的人工智能芯片,不可为一次突破性的尝试。

随着新技术的兴起,越来越多的公司争相开发先进的生成式人工智能模型或将其集成到自己的系统中,对部署工具所需的高性能图形处理单元(GPU)的需求激增而导致短缺。增强型计算机芯片对于运行训练和部署人工智能算法所涉及的无数计算至关重要,但很少有公司具备制造的实力。

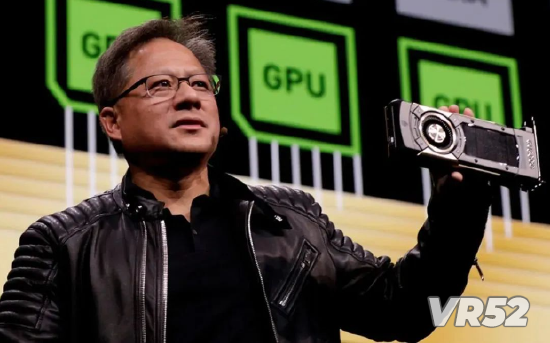

总部位于加利福尼亚州圣克拉拉的英伟达公司是人工智能芯片领域的主导巨头,但无法生产足够的产品来满足需求。行业分析师估计Nvidia控制着80%至95%的市场份额,并且鉴于其在该行业的控制地位,显然英伟达的盈利将进一步增长。

虽然英伟达誓言要提高产量以满足人工智能需求的激增,但到目前为止还不足以跟上持续的繁荣。

路透社消息称,OpenAI在过去一年中讨论了其他支持其芯片供应的选择,包括“与包括Nvidia在内的其他芯片制造商进行更密切的合作,并使其供应商多元化,超越Nvidia。”显然OpenAI正在考虑采取多种策略来推进其芯片雄心,包括收购一家AI芯片制造商或加大内部设计芯片的力度。

路透社消息称,近期OpenAI首席执行官Sam Altman已将收购更多人工智能芯片作为公司的首要任务,不过目前OpenAI对此消息拒绝置评。

目前,OpenAI与大多数竞争对手一样,依靠基于GPU的硬件来开发ChatGPT、GPT-4和DALL-E 3等模型。GPU并行执行多项计算的能力使其非常适合训练当今最强大的人工智能。

显然生成式人工智能的蓬勃发展对于Nvidia等GPU制造商来说是一笔意外之财——却给GPU供应链带来了巨大压力。微软在夏季财报中警告称,运行人工智能所需的服务器硬件严重短缺,可能会导致服务中断。

据此前报道,Nvidia性能最好的AI芯片在2024年之前都已售空。

同时GPU对于运行和服务OpenAI模型也至关重要;该公司依靠云中的GPU集群来执行客户的工作负载。但它们的成本极高。Bernstein分析师Stacy Rasgon的一项分析发现,如果ChatGPT查询规模增长到Google搜索规模的十分之一,最初需要价值约481亿美元的GPU,每年需要价值约160亿美元的芯片才能保持运行。

就过往情况来看,OpenAI并不是第一个尝试创建自己的人工智能芯片的公司。谷歌有一个处理器,即TPU(“张量处理单元”的缩写),用于训练PaLM-2和Imagen等大型生成式AI系统。亚马逊向AWS客户提供用于训练(Trainium)和推理(Inferentia)的模型也有专有芯片。此外据报道,微软正在与AMD合作开发一款名为Athena的内部AI芯片,据说OpenAI正在测试该芯片。

当然,OpenAI在研发方面的大力投资处于有利地位。该公司已筹集超过110亿美元的风险投资,年收入接近10亿美元。《华尔街日报》最近报道称,该公司正在考虑出售股票,其二级市场估值可能飙升至900亿美元。

但硬件是一个无情的行业——尤其是人工智能芯片。

去年,据称在与微软的交易失败后,人工智能芯片制造商Graphcore的估值被削减了10亿美元,该公司表示,由于“极具挑战性”的宏观经济环境,该公司正计划裁员。(过去几个月,随着Graphcore报告收入下降和亏损增加,情况变得更加严峻。)与此同时,英特尔旗下的人工智能芯片公司HabanaLabs解雇了估计10%的员工。Meta的定制人工智能芯片工作一直存在问题,导致该公司废弃了一些实验硬件。

VR52网成立于2015年,平台提供VR头显、AR眼镜、配件外设、厂商、测评、行业资讯、游戏与应用、展会活动等。