《Lasertag》开发者在Quest 3系列上实现“无感建模”,绕过Meta房间扫描流程

在当前主流的混合现实设备中,Meta的Quest 3和Quest 3S虽然具备房间扫描与场景网格生成功能,但在实际使用中仍存在一些用户体验上的痛点。而独立开发者Julian Triveri在其开发的多人混合现实射击游戏《Lasertag》中,尝试通过深度API实现了“连续场景理解”的新方案,有效绕过了Meta现有的房间设置流程。

Quest 3系列支持用户对房间进行3D扫描,生成可用于混合现实应用的场景网格(Scene Mesh),使虚拟对象能够与真实环境中的家具、墙壁等物理结构互动。然而,这一系统存在两个主要问题:

需要手动初始化扫描:整个过程可能耗时几十秒到数分钟,用户需主动完成扫描动作,显著增加了启动应用前的操作门槛。

静态建模无法反映环境变化:一旦扫描完成,场景网格即固定不变。如果之后房间布局发生变化(如移动家具或有人走动),除非重新扫描,否则系统不会更新模型。

这些问题限制了混合现实体验的流畅性和自然度,尤其是在动态或多用户场景中表现尤为明显。

为了提升体验,《Lasertag》选择不依赖Meta官方的场景网格系统,而是直接利用Quest 3的Depth API——该接口提供实时的第一人称深度帧,用于判断物体之间的空间关系。

目前公开版本的《Lasertag》已通过Depth API实现激光与真实环境的即时碰撞检测,并支持动态遮挡效果。而在beta测试版本中,Triveri进一步探索了更复杂的连续建模能力。

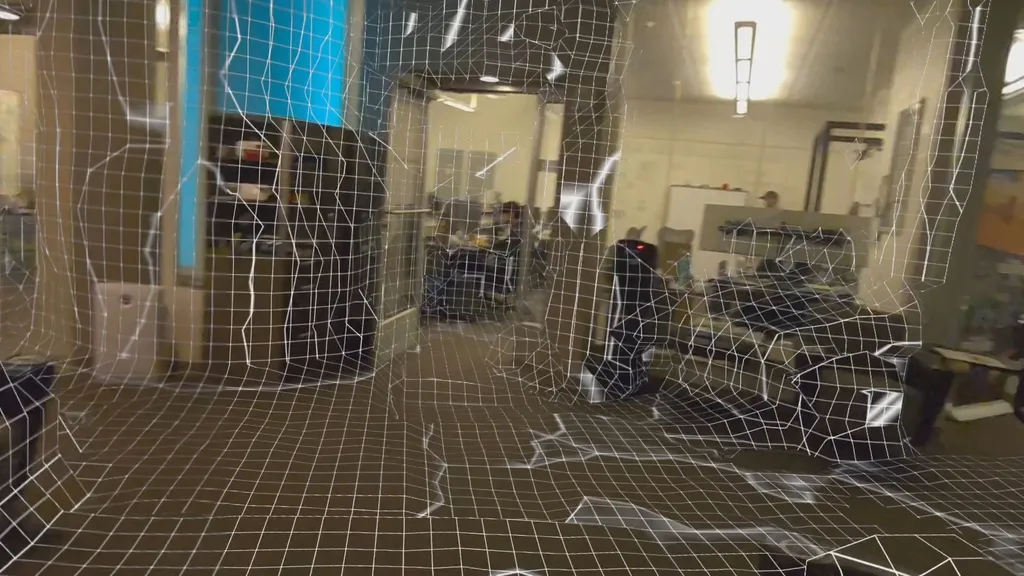

在beta版本中,开发者将每一帧的深度信息逐步融合,在GPU上构建出一个代表用户环境的3D体积纹理(Volume Texture)。这种方式让用户即使没有直视某个区域,只要之前看过,系统也能推测其存在并进行碰撞判断。

此外,Triveri还在内部实验中尝试将这些数据转换为网格模型,借助Unity的一个开源行进立方体算法(Marching Cubes)实现近似实时的三维重建。

甚至在早期版本中,他还尝试让多台设备共享各自的深度数据,形成“联网高度图”(networked heightmap),从而实现协同建模。尽管这项功能尚未正式上线,但其思路为未来多人混合现实协作提供了重要参考。

值得注意的是,Apple Vision Pro 和 Pico 4 Ultra 等设备已经实现了类似的“持续建模”机制:无需初始房间扫描,头显会在后台持续更新环境模型。它们之所以能做到这一点,得益于硬件级别的深度传感器。

而Quest 3/3S则依靠计算视觉技术来推断深度信息,尤其在配合红外图案辅助的情况下。这种软件层面的深度推算不仅消耗大量CPU/GPU资源,还显著影响电池续航。这也是为何许多Quest应用至今仍未启用动态遮挡功能的原因。

因此,虽然《Lasertag》的做法在技术上具有前瞻性,但也意味着更高的性能与能耗代价。这正是Meta目前尚未将其纳入官方场景网格系统的主要原因。

今年初,Meta曾透露未来计划让场景网格具备自动更新能力,以适应环境变化。不过从其表述来看,依然会保留初始扫描作为基准,而不是完全转向实时建模。

《Lasertag》的成功实践表明,在现有硬件条件下,通过深度API实现连续场景理解是可行的。它不仅提升了用户体验,也为未来的混合现实应用打开了更多可能性。随着硬件和算法的进步,或许我们很快就能看到更轻量、高效的“无感建模”方案走向主流。

VR52网成立于2015年,平台提供VR头显、AR眼镜、配件外设、厂商、测评、行业资讯、游戏与应用、展会活动等。