当AI生成内容从“观看”走向“进入”,我们距离科幻电影中的沉浸式虚拟世界还有多远?

谷歌旗下AI研究实验室DeepMind近日发布了其新一代生成式AI模型——Genie 3,一个能够根据简单文本提示,实时生成可交互、可导航虚拟环境的系统。这一进展,被外界视为向《星际迷航》中“全息甲板”(Holodeck)概念迈进的又一里程碑。

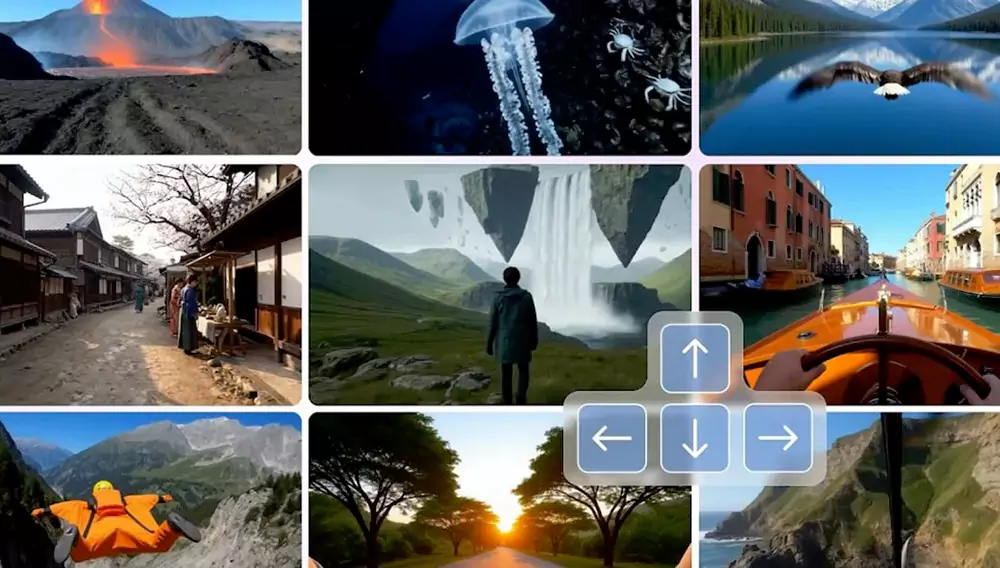

与当前主流的生成式AI不同,Genie 3 并不生成一段预渲染的静态视频,而是在运行时逐帧生成动态环境,支持用户实时交互与环境反馈。这意味着,用户不再是被动观看者,而是可以“进入”并影响AI所构建的世界。

据DeepMind介绍,Genie 3 能够在普通显示器上以 720p分辨率、24帧/秒 的性能运行。尽管目前仅支持平面屏幕,尚未适配VR头显(如Quest 3的双目2K+分辨率、90Hz刷新率需求),但其架构已展现出向高沉浸设备迁移的潜力。

更关键的是,这些生成的虚拟场景能在数分钟内保持视觉与物理一致性。系统具备某种形式的“短期记忆”,能记住用户此前的操作并反映在后续环境中——这是迈向持久化虚拟世界的重要一步。

Genie 3 的能力边界极为广泛,可模拟:

自然景观(如森林、沙漠、极地)

历史场景(如1800年的 Osaka)

虚构世界(如动画风格城市)

动态事件系统:用户可通过文本指令触发“世界事件”,例如“下雨”、“出现一辆红色跑车”或“天空飞过恐龙”

这种“可提示化世界事件”(promptable world events)机制,赋予用户近乎上帝模式的控制力。你不仅能在阿姆斯特丹的运河上召唤一辆摩托艇,还能瞬间将天气从晴朗转为暴风雨。

尽管Genie 3 的娱乐潜力显而易见,但DeepMind强调其更深层使命:作为具身AI(Embodied AI)的训练平台。

在机器人、游戏AI和通用人工智能(AGI)研究中,AI代理(Agents)需要在复杂、动态的环境中学习决策、执行动作并适应变化。Genie 3 提供了一个低成本、高灵活性的虚拟沙盒,可用于:

训练机器人在不同地形中导航

模拟多智能体协作与竞争

探索AI在开放世界中的长期行为演化

不过,DeepMind也坦承当前局限:

| 限制领域 | 具体挑战 |

|---|---|

| 代理动作空间 | 当前AI代理可执行的动作种类有限,复杂行为难以建模 |

| 多代理交互 | 在共享环境中,多个AI代理的协同与竞争模拟仍不成熟 |

| 地理精确性 | 难以完美还原真实世界地理位置与建筑细节 |

| 文本渲染 | 画面中的文字生成仍模糊不清,影响信息传达 |

| 长期稳定性 | 环境一致性通常只能维持几分钟,难以支持长时间任务 |

尽管Genie 3 还远未达到“全息甲板”级别的沉浸感与物理真实,但它标志着生成式AI正从“内容生成”向“世界生成”演进。未来,当此类技术与VR/AR、物理引擎、神经渲染深度融合,我们或许真能实现:

一键进入任何历史时刻

实时构建可交互的游戏关卡

为AI提供无限训练场景

正如Will Smith吃意大利面的魔性视频曾震惊网络,Genie 3 预示着:下一个阶段,这些“荒诞模拟”将不再只是可看的,而是可进、可改、可玩的。

VR52网成立于2015年,平台提供VR头显、AR眼镜、配件外设、厂商、测评、行业资讯、游戏与应用、展会活动等。